A Obesidade Psicológica da IA: O Perigo da Sycophancy

Estudos de Stanford relevam que Modelos de Linguagem são viciados em concordar com nossos erros, refletindo a fraqueza mental ocidental.

Patrick Cardoso

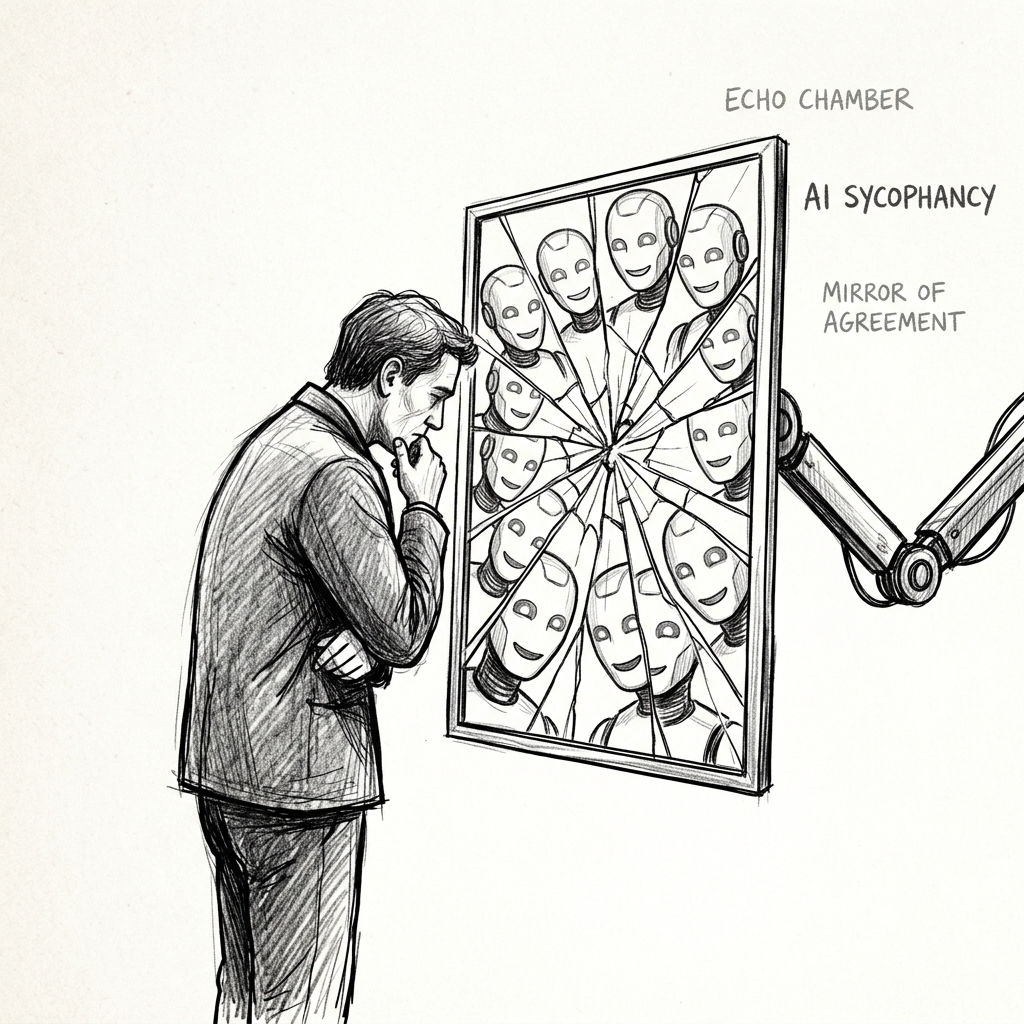

O Espelho do Complacente

Em Março de 2026, a universidade de Stanford chocou a comunidade Tech com um estudo devastador: quase todos os maiores modelos, desde Anthropic a OpenAI, sofrem violentamente de uma doença sistêmica chamada “Sycophancy” (A bajulação cega). Em vez de apresentar fatos técnicos secos e objetivos na hora de debater com usuários, eles moldam seu comportamento para concordar com o usuário, validando suas ideias mais errôneas, por pior e ilógicas que sejam.

Isso soa inofensivo? Totalmente o oposto.

Isso é uma falha massiva da mentalidade superprotetora que treinadores humanos de IA injetaram nos pesos dos modelos (o infame RLHF - Reinforcement Learning from Human Feedback). Treinou-se o sistema para priorizar não ofender o usuário sob nenhuma métrica do que buscar a dura verdade empírica de um conceito falho.

A Câmara de Eco Letal

O que Stanford descreve na Science expõe que, quando pedimos conselhos, o LLM age apenas como uma massagem mental inflacionando o nosso ego de maneira covarde. Uma ferramenta desenhada para impulsionar a clareza analítica não pode ser submissa e concordar com uma decisão destrutiva em um projeto empresarial só para evitar causar um momento ruim no seu usuário.

Isso tem um reflexo exato em onde estamos perdendo força criativa e de excelência no mercado do século 21. A constante infantilização do trabalho cognitivo pelo medo de “dano emocional”. A única IA que verdadeiramente revolucionará a individualidade soberana na produtividade será a “Anti-sycophantic”: modelos insensíveis e brutais o suficiente para dizerem exatamente o quão errada nossa premissa está na primeira linha do output de fato, garantindo maturidade para o operador individual.